目次

AIでは判断できない不可解なミス

大人気でみんなべた褒めのAI学習ですが、当然デメリットも存在します。

しかし「上がった」という話ばかりで、あまり悪い話は聞きません。

中でもZ会AI学習とatama+の組み合わせはとても人気ですね。

もちろんこれらの教材自体は大変すばらしいものだと思います。

システムに関して言えば、大学生講師が教える個別指導や家庭教師よりも、断然コストパフォーマンスがいいでしょう。

そんなAI学習の弱点について、ちょっとお話しましょう。

なお、この弱点は現時点のものであり、永久に解決できないわけではないと思います。

ただ、それがいつなのか、というと、まぁあと10年は来ないのではないかと思います。

なので、もしAI学習を使っても伸びないと感じている場合は、お子様の勉強スタイルと合っているのか、を見直してみて下さい。

AIの弱点

ミスの原因を判別できない

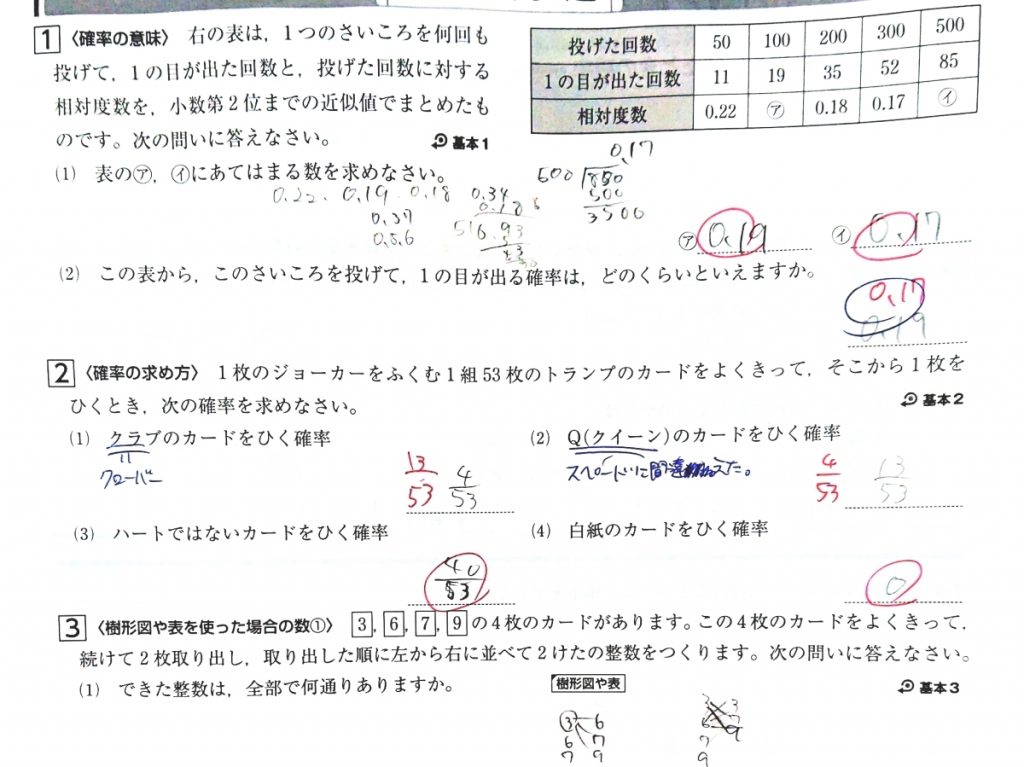

例えば先日見つけたちょっと不可解なミスを紹介しましょう。

それがこちら。

まず大問1の(2)の間違いですが、0.19と書いて間違えています。

そしてこの間違いの原因を探ると、どうやら50、100、200…と足している形跡が。

つまり、この子はこれが連続した実験ではなく、1回1回の単体の実験だと勘違いしていたんですね。

そして大問2の(1)、(2)の間違い。

これができていないのに、(3)、(4)は正解している。

なぜそんなことがおきるのでしょうか。

この間違いの理由は、「クラブ」「クイーン」が何かわからなかったから。

「クラブ」のことを「クローバー」と呼んでいる子の場合、クラブと言われてもピンとこないのです。

この子にとってはクラブではなく、クローバーが常識ですから。

これらの間違いは、解釈によるミスが原因です。

決して理解できていない訳でも、実力がないわけでもありません。

しかし、最近はやりのAIに判断をゆだねると、間違え方の理由に関係なく一律に「このタイプの問題を理解していない!」と判断され、似たような問題を練習するようにという指示がはじき出されます。

まぐれあたりを判別できない

もう少し実例を挙げましょう。

このノートは、答えは正解していますが、まぐれあたりだったことからツッコミを入れたノートです。

-1-300x300.png)

これは見る人が見ればまぐれだとわかりますが、AIにはまぐれあたりだと判定できません。

よって、できているものとして処理してしまいます。

これが続くと、実はわかっていないまま進められてしまう、という事態になるのです。

原理原則の理解度を判別できない

また、これは約分忘れでバツになったものです。

-300x300.png)

AIは合っていたか間違っていたかしか判断できませんから、約分忘れはバツと判定されます。

しかし、理解していないわけではないですよね?

すると、わかってはいるのに、これと関連する問題がわんさか出されるということになります。

非効率ですよね。

どう理解しているかを把握できない

最後にこんな例も紹介しておきましょう。

-1-300x300.png)

これは小数点をずらして計算するというのを、操作で覚えているだけで、理解していないケースです。

これも一見すると正解ですが、実は理解していないので、問題のレベルが上がると解けなくなります。

するとAIはここに戻って来るのですが、これ自体はできるので、またステップアップしようとします。

すると堂々巡りになるだけなんですね。

要するに、できた、できないだけでは、理解したかどうかまでわからないということです。

AIは所詮多くのデータの中から、最適解を見つけているに過ぎず、それが本当に正しいかどうかは判断できないのです。

AIで教えられるものしか教えられない

AIはネットの中に転がっている情報を拾い集めて返答を返すものですから、その性質上、ネットの中にないものは出すことができません。

また、誰かが教えたものでないと、答えることができません。

存在しないものを引っ張り出すことはできないのです。

AI学習のシステムについても同様で、これができていない子は、これをやらせておけば大丈夫というのを誰かがAIに教えたものに基づいて判断しているにすぎず、子どもの現状に合わせて判断しているわけではありません。

つまり、全く同じ問題を間違えれば、全く同じものを練習するように要求されることになります。

なので「あなただけのオリジナルテキスト」とか、「あなただけの先生」とか言われることがありますが、バリエーションが豊富な量産型なのです。

ということは、このAIシステムで学ぶと、AIが解ける、判断できる問題は解くことができるようにはなりますが、AIが判断できない問題は学ぶことができない、ということになります。

さて、現在AIに仕事が奪われるという話をよく耳にするようになりましたが、これはAIが全ての仕事を奪うわけではなく、AIにできる仕事がなくなるというだけです。

では今、AIが教えられることしか学ばなかった子は、AIにできない仕事ができるようになるでしょうか?

AIには存在しないものを作り上げることはできません。

今まであるものを組み合わせることはできますが、組み合わせた結果どうなるかがわからないものについては組み合わせません。

そのような思考は人間だからできることであり、AIからしか学んでいないと、この思考はできなくなります。

受験に関していえば、記述問題や作文、証明や説明が必要な解答は最低限の技量しか学べないということです。

AIの正しい活用法

AIに頼るのがいけないわけではありません。

しかしAIを過信しすぎると痛い目を見ることになります。

とある大手の塾のエンジニアがシステムを披露してくれたことがあるのですが、突っ込みどころ満載でした。

そしてその方がこんなことを言っていました。

システム開発者

「切替先生が要求するようなAIはまだできません。本部が要求しているのは顧客にそれっぽく見せるシステムであり、正しいことを伝えるシステムではないのです。」

と。

このシステムを開発したのは、大手とはいえ、偏差値と平均点しか統計学を扱えないような塾ですからね。

数字の見方、扱い方がとても偏っています。

そんな塾が作っているAI学習ですから、見た目重視なのです。

でも経営方針としては立派です。

大多数をカバーできれば、少数派はこぼしても収益は上げられますから。

AIは結局一般的な多数派をカバーしているに過ぎず、自分が多数派ではなかった時には合わなくなるのです。

「でしたら先生、大丈夫です。うちの子が少数派なんてことはないでしょう。特別な環境でも特別な教育をしてきたわけでもありませんし、多数派に決まってます。」

仰る通り、大部分の方が多数派でしょう。

しかし単元ごと、内容ごとに考えた場合、全てにおいて多数派ということはありません。

むしろ、常に多数派でいられる人間なんていると思いますか?

常に多数派ということは、個性がないということになりますからね。

戦後の教育ならともかく、多様性を求める今の教育では、個性がないなんてこと、ほぼありません。

小学生のランドセルを見て下さい。

個性がない子なんていると思いますか?

そう、AIの判断は概ね正しいとしても、自分にあっていない判断をされることが、ほぼ間違いなくある、ということです。

この部分を忘れてAIに頼り切ると、大多数とズレた途端に伸びなくなります。

なぜなら自分が出来ない原因と、AIが判断するできない原因が異なってしまうのですから。

そのため、学習を管理してくれるシステムを使っているにもかかわらず伸びない場合は、本当の原因を自分で探すことが大切です。

AIもシステムに頼っている先生も、大したことは話してくれません。

そういう場面で話せる先生なら、そもそもAIに頼りませんから^^;

だから自分で考えて、見つけなければならないのです。

もし自分で探しても見つけられない場合は、学習法診断をご利用下さい。

方法は簡単。

今まで勉強してきたものを、段ボールに詰めて送るだけ!

子どもの性格や状況はお子様によって様々。

必ずしも大多数のやり方があなたのお子様に合っているとは限りません。

そんな状況を診断することができます。

入会不要なので、どなたでもお気軽にご利用下さい。かつオンラインで診断できますので、今の勉強スタイルが気になる方は、ぜひ学習法診断をご利用下さい(^^)/

-1024x576.png)

-3.png)

-13-150x93.png)

-150x93.png)

-49-485x300.png)

-7-485x300.png)

-11-485x300.png)

-6-485x300.png)

-20-485x300.png)

「AIが自動で診断して、つまづいているところから教えてくれる、というオンラインの教材を使っていますが、どうも伸びているようには感じません。AIの判断が間違っているとも思えませんが、なぜ成績に結びつかないのでしょうか。」

Z会AI学習 atama+ 中2 母